Un nuevo artículo de investigación de Canadá ha propuesto un marco que introduce deliberadamente la compresión JPEG en el esquema de entrenamiento de una red neuronal y logra obtener mejores resultados y una mejor resistencia a los ataques adversarios.

Esta es una idea bastante radical, ya que la opinión general actual es que los artefactos JPEG, que están optimizados para la visualización humana y no para el aprendizaje automático, generalmente tienen un efecto nocivo en las redes neuronales entrenadas con datos JPEG.

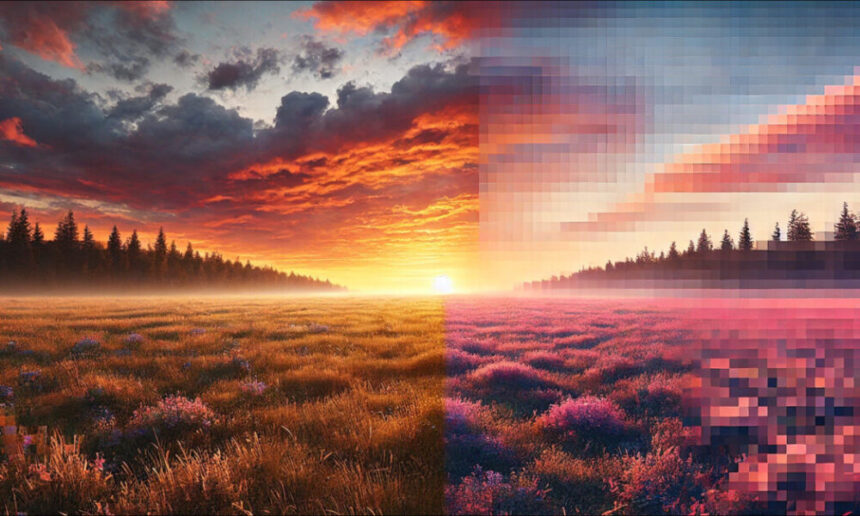

Un ejemplo de la diferencia de claridad entre imágenes JPEG comprimidas con diferentes valores de pérdida (una pérdida mayor permite un tamaño de archivo más pequeño, a expensas de la delineación y las bandas en los gradientes de color, entre otros tipos de artefactos). Fuente: https://forums.jetphotos.com/forum/aviation-photography-videography-forums/digital-photo-processing-forum/1131923-how-to-fix-jpg-compression-artefacts?p=1131937#post1131937

Un informe de 2022 de la Universidad de Maryland y Facebook AI afirmó que la compresión JPEG “incurre en una importante penalización de rendimiento” en el entrenamiento de redes neuronales, a pesar de trabajos anteriores que afirmaban que las redes neuronales son relativamente resistentes a los artefactos de compresión de imágenes.

Un año antes de esto, había surgido una nueva corriente de pensamiento en la literatura: que la compresión JPEG en realidad podría aprovecharse para mejorar los resultados en el entrenamiento de modelos.

Sin embargo, aunque los autores de ese artículo pudieron obtener mejores resultados en el entrenamiento de imágenes JPEG de distintos niveles de calidad, el modelo que propusieron era tan complejo y engorroso que no era practicable. Además, el uso por parte del sistema de configuraciones de optimización JPEG predeterminadas (cuantización) demostró ser una barrera para la eficacia del entrenamiento.

Un proyecto posterior (de 2023) Compresión compatible con JPEG para DNN Vision) experimentó con un sistema que obtuvo resultados ligeramente mejores a partir de imágenes de entrenamiento comprimidas en JPEG con el uso de un modelo de red neuronal profunda (DNN) congelada. Sin embargo, congelar partes de un modelo durante el entrenamiento tiende a reducir la versatilidad del modelo, así como su resiliencia más amplia a datos nuevos.

JPEG-DL

En cambio, el nuevo trabajo, titulado Aprendizaje profundo inspirado en JPEGofrece una arquitectura mucho más simple, que incluso puede imponerse a los modelos existentes.

Los investigadores, de la Universidad de Waterloo, afirman:

«Los resultados muestran que JPEG-DL supera significativa y consistentemente al DL estándar en varias arquitecturas DNN, con un aumento insignificante en la complejidad del modelo.

Específicamente, JPEG-DL mejora la precisión de la clasificación hasta en un 20,9% en algunos conjuntos de datos de clasificación detallados, al tiempo que agrega solo 128 parámetros entrenables al proceso de DL. Además, la superioridad de JPEG-DL sobre el DL estándar queda demostrada aún más por la mayor solidez adversa de los modelos aprendidos y los tamaños de archivo reducidos de las imágenes de entrada.’

Los autores sostienen que un nivel óptimo de calidad de compresión JPEG puede ayudar a una red neuronal a distinguir los sujetos centrales de una imagen. En el siguiente ejemplo, vemos resultados de referencia (izquierda) que combinan el pájaro con el fondo cuando la red neuronal obtiene las características. Por el contrario, JPEG-DL (derecha) consigue distinguir y delimitar el sujeto de la fotografía.

Pruebas con métodos básicos para JPEG-DL. Fuente: https://arxiv.org/pdf/2410.07081

‘Este fenómeno’ ellos explican, ‘Denominado “ayuda de compresión” en el artículo (2021), se justifica por el hecho de que la compresión puede eliminar el ruido y las características perturbadoras del fondo, resaltando así el objeto principal en una imagen, lo que ayuda a las DNN a hacer mejores predicciones.’

Método

JPEG-DL introduce un cuantificador suave diferenciable, que reemplaza la operación de cuantificación no diferenciable en una rutina de optimización JPEG estándar.

Esto permite la optimización de las imágenes basada en gradientes. Esto no es posible en la codificación JPEG convencional, que utiliza un cuantificador uniforme con una operación de redondeo que se aproxima al coeficiente más cercano.

La diferenciabilidad del esquema de JPEG-DL permite la optimización conjunta tanto de los parámetros del modelo de entrenamiento como de la cuantificación de JPEG (nivel de compresión). La optimización conjunta significa que tanto el modelo como los datos de entrenamiento se adaptan entre sí en el proceso de un extremo a otro y no es necesario congelar capas.

Básicamente, el sistema personaliza la compresión JPEG de un conjunto de datos (sin procesar) para que se ajuste a la lógica del proceso de generalización.

Esquema conceptual para JPEG-DL.

Se podría suponer que los datos brutos serían el material ideal para la formación; después de todo, las imágenes se descomprimen completamente en un espacio de color completo apropiado cuando se ejecutan en lotes; Entonces, ¿qué diferencia hace el formato original?

Bueno, dado que la compresión JPEG está optimizada para la visualización humana, elimina áreas de detalle o color de una manera concordante con este objetivo. Dada una imagen de un lago bajo un cielo azul, se aplicarán mayores niveles de compresión al cielo, porque no contiene detalles “esenciales”.

Por otro lado, una red neuronal carece de filtros excéntricos que nos permitan concentrarnos en temas centrales. En cambio, es probable que considere cualquier artefacto de bandas en el cielo como datos válidos que deben asimilarse en su espacio latente.

Aunque un humano ignorará las bandas en el cielo, en una imagen muy comprimida (izquierda), una red neuronal no tiene idea de que este contenido debe desecharse y necesitará una imagen de mayor calidad (derecha). Fuente: https://lensvid.com/post-processing/fix-jpeg-artifacts-in-photoshop/

Por lo tanto, es poco probable que un nivel de compresión JPEG se ajuste a todo el contenido de un conjunto de datos de entrenamiento, a menos que represente un dominio muy específico. Las fotografías de multitudes requerirán mucha menos compresión que una fotografía de enfoque estrecho de un pájaro, por ejemplo.

Los autores observan que aquellos que no están familiarizados con los desafíos de la cuantificación, pero que están familiarizados con los conceptos básicos de la arquitectura de los transformadores, pueden considerar estos procesos como una “operación de atención”, en términos generales.

Datos y pruebas

JPEG-DL se evaluó frente a arquitecturas basadas en transformadores y redes neuronales convolucionales (CNN). Las arquitecturas utilizadas fueron EfficientFormer-L1; ResNet; VGG; red móvil; y ShuffleNet.

Las versiones de ResNet utilizadas fueron específicas del conjunto de datos CIFAR: ResNet32, ResNet56 y ResNet110. Se eligieron VGG8 y VGG13 para las pruebas basadas en VGG.

Para CNN, la metodología de capacitación se derivó del trabajo de 2020 Destilación de representación contrastiva (CRD). Para EfficientFormer-L1 (basado en transformador), el método de entrenamiento de la salida de 2023 Inicializando modelos con modelos más grandes fue usado.

Para las tareas detalladas presentadas en las pruebas, se utilizaron cuatro conjuntos de datos: Stanford Dogs; Flowers de la Universidad de Oxford; CUB-200-2011 (Aves CalTech); y mascotas (‘Gatos y perros’una colaboración entre la Universidad de Oxford y Hyderabad en India).

Para tareas detalladas en CNN, los autores utilizaron PreAct ResNet-18 y DenseNet-BC. Para EfficientFormer-L1, la metodología descrita en el documento antes mencionado Inicializando modelos con modelos más grandes fue usado.

En el CIFAR-100 y en las tareas detalladas, las diferentes magnitudes de las frecuencias de la Transformada de Coseno Discreto (DCT) en el enfoque de compresión JPEG se manejaron con el optimizador Adam, para adaptar la tasa de aprendizaje para la capa JPEG en todos los modelos que fueron probado.

En las pruebas de ImageNet-1K, en todos los experimentos, los autores utilizaron PyTorch, con SqueezeNet, ResNet-18 y ResNet-34 como modelos principales.

Para la evaluación de optimización de la capa JPEG, los investigadores utilizaron Stochastic Gradient Descent (SGD) en lugar de Adam, para un rendimiento más estable. Sin embargo, para las pruebas ImageNet-1K, el método del artículo de 2019 Cuantización del tamaño del paso aprendido estaba empleado.

Precisión de validación superior a la primera para la línea de base frente a JPEG-DL en CIFAR-100, con desviaciones estándar y media promediadas en tres ejecuciones. A continuación, la precisión de validación principal en diversas tareas de clasificación de imágenes detalladas, en varias arquitecturas de modelos, nuevamente, promedió tres pasadas.

Al comentar sobre la ronda inicial de resultados ilustrada anteriormente, los autores afirman:

‘En los siete modelos probados para CIFAR-100, JPEG-DL proporciona mejoras consistentemente, con ganancias de hasta el 1,53% en la precisión superior. En las tareas detalladas, JPEG-DL ofrece un aumento sustancial del rendimiento, con mejoras de hasta un 20,90 % en todos los conjuntos de datos utilizando dos modelos diferentes.’

Los resultados de las pruebas ImageNet-1K se muestran a continuación:

Resultados de precisión de validación de primer nivel en ImageNet en diversos marcos.

Aquí el documento dice:

‘Con un aumento trivial en la complejidad (agregando 128 parámetros), JPEG-DL logra una ganancia del 0,31% en la precisión superior para SqueezeNetV1.1 en comparación con la línea base usando una sola ronda de operación (cuantización).

“Al aumentar el número de rondas de cuantificación a cinco, observamos una mejora adicional del 0,20%, lo que lleva a una ganancia total del 0,51% con respecto a la línea base”.

Los investigadores también probaron el sistema utilizando datos comprometidos por los enfoques de ataque adversario: Método de gradiente rápido con firma (FGSM) y Descenso de gradiente proyectado (PGD).

Los ataques se realizaron contra CIFAR-100 en dos de los modelos:

Resultados de las pruebas para JPEG-DL, frente a dos marcos de ataque adversarios estándar.

Los autores afirman:

“(Los) modelos JPEG-DL mejoran significativamente la robustez adversaria en comparación con los modelos DNN estándar, con mejoras de hasta un 15% para FGSM y un 6% para PGD”.

Además, como se ilustró anteriormente en el artículo, los autores realizaron una comparación de mapas de características extraídas utilizando GradCAM++, un marco que puede resaltar las características extraídas de manera visual.

Una ilustración de GradCAM++ para la clasificación de imágenes de referencia y JPEG-DL, con las características extraídas resaltadas.

El artículo señala que JPEG-DL produce un resultado mejorado y que en un caso incluso fue capaz de clasificar una imagen que la línea base no pudo identificar. Con respecto a la imagen ilustrada anteriormente que presenta pájaros, los autores afirman:

‘(Es) evidente que los mapas de características del modelo JPEG-DL muestran un contraste significativamente mejor entre la información del primer plano (el pájaro) y el fondo en comparación con los mapas de características generados por el modelo de referencia.

‘Específicamente, el objeto de primer plano en los mapas de características JPEG-DL está encerrado dentro de un contorno bien definido, lo que lo hace visualmente distinguible del fondo.

“Por el contrario, los mapas de características del modelo de referencia muestran una estructura más fusionada, donde el primer plano contiene mayor energía en las frecuencias bajas, lo que hace que se mezcle más suavemente con el fondo”.

Conclusión

JPEG-DL está diseñado para usarse en situaciones donde hay datos sin procesar disponibles, pero sería muy interesante ver si algunos de los principios presentados en este proyecto podrían aplicarse al entrenamiento de conjuntos de datos convencionales, en los que el contenido puede ser de menor calidad (como ocurre frecuentemente con conjuntos de datos a hiperescala extraídos de Internet).

Tal como están las cosas, esto sigue siendo en gran medida un problema de anotación, aunque se ha abordado en el reconocimiento de imágenes basado en el tráfico y en otros lugares.

Publicado por primera vez el jueves 10 de octubre de 2024