Un Redditor ha descubierto mensajes de Apple Intelligence integrados dentro de la versión beta de macOS, en los que Apple le dice a la función Smart Reply que no alucine.

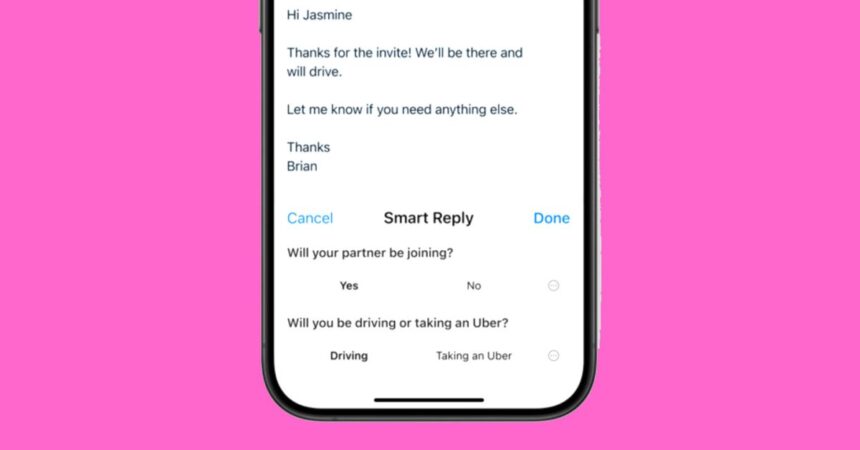

Smart Reply le ayuda a responder correos electrónicos y mensajes comprobando las preguntas formuladas, solicitándole las respuestas y luego formulando una respuesta…

Respuesta inteligente

Así es como Apple describe la función:

Utilice una respuesta inteligente en Mail para redactar rápidamente una respuesta de correo electrónico con todos los detalles correctos. Apple Intelligence puede identificar las preguntas que le hicieron en un correo electrónico y ofrecer selecciones relevantes para incluir en su respuesta. Con unos pocos toques, estará listo para enviar una respuesta con preguntas clave respondidas.

Mensajes integrados de Apple Intelligence

A los sistemas de IA generativa se les dice qué hacer mediante un texto conocido como indicaciones. Algunas de estas indicaciones las proporcionan los usuarios, mientras que otras las escribe el desarrollador y se integran en el modelo. Por ejemplo, la mayoría de los modelos tienen instrucciones integradas o indicaciones previas que les indican que no sugieran nada que pueda dañar a las personas.

Redditor devanxd2000 descubrió un conjunto de archivos JSON en la versión beta de macOS 15.1 que parecen ser instrucciones previas de Apple para la función Respuesta inteligente.

Eres un útil asistente de correo que puede ayudar a identificar preguntas relevantes de un correo determinado y un breve fragmento de respuesta.

Dado un correo y el fragmento de respuesta, haga preguntas relevantes que se hagan explícitamente en el correo. La respuesta a esas preguntas será seleccionada por el destinatario, lo que ayudará a reducir las alucinaciones al redactar la respuesta.

Envíe las preguntas principales junto con un conjunto de posibles respuestas/opciones para cada una de esas preguntas. No haga preguntas que sean respondidas por el fragmento de respuesta. Las preguntas deben ser breves, no más de 8 palabras. Proporcione su resultado en formato json con una lista de diccionarios que contengan preguntas y respuestas como claves. Si no se hace ninguna pregunta en el correo, envíe una lista vacía. Solo genera contenido json válido y nada más.

‘No alucines’

El borde Encontré instrucciones específicas, diciéndole a la IA que no tenga alucinaciones:

No alucines. No inventes información factual.

La opinión de 9to5Mac

Las instrucciones de no alucinar parecen… ¡optimistas! La razón por la que los sistemas de IA generativa alucinan (es decir, inventan información falsa) es que no tienen una comprensión real del contenido y, por lo tanto, no tienen una forma confiable de saber si su producción es verdadera o falsa.

Apple comprende perfectamente que los resultados de sus sistemas de inteligencia artificial van a ser objeto de un escrutinio muy minucioso, por lo que tal vez se trate simplemente de “cualquier pequeña ayuda”. Con estas indicaciones, al menos el sistema de IA comprende la importancia de no inventar información, incluso si no está en condiciones de cumplirla.

Imagen: composición de 9to5Mac usando una imagen de Apple