Es un testimonio para el equipo de marketing de Nvidia que una de sus palabras de moda se haya convertido en el lenguaje común. No sólo la primera generación NvidiaGeForce 256 nos presenta su ahora famosa marca de gráficos para juegos GeForce, pero también trajo consigo el término “GPU” a la PC para juegos. Ahora, dos décadas y media después, Nvidia celebra el cumpleaños número 25 de la GeForce 256 con un vídeo y palomitas de maíz verdes. Aquí, recordamos lo que hizo funcionar un verdadero clásico moderno de la era de la PC.

Volviendo a ese término GPU, es una sigla que ahora usamos como abreviatura de cualquier chip gráfico de PC, como se encuentra en las mejores tarjetas gráficas, pero comenzó en la PC como un eslogan de marketing de Nvidia. Para darle una idea de cuánto tiempo hace de esto, conocí el término “GPU” en un comunicado de prensa en papel la misma semana que comencé mi primer trabajo de periodismo tecnológico en septiembre de 1999.

En ese entonces no recibíamos comunicados de prensa por correo electrónico; nos los enviaban físicamente y el asistente editorial los clasificaba todos en una caja para que el equipo los examinara detenidamente. “En un evento que marca el comienzo de una nueva era de interactividad para PC, Nvidia presentó hoy la GeForce 256, la primera unidad de procesamiento gráfico (GPU) del mundo”, afirmó.

En ese momento, pensé que parecía pomposo: ¿cómo podría este relativamente recién llegado a la escena de los gráficos 3D tener el descaro de pensar que podría cambiar el lenguaje de los gráficos de PC? Pero ahora veo que fue una genialidad del marketing. La “GPU” no solo se mantuvo durante las próximas décadas, sino que también significó que Nvidia era la única empresa con una GPU para PC en ese momento.

Transformación e iluminación de GeForce 256

De hecho, la primera GPU de Nvidia manejaba gráficos 3D de manera bastante diferente a sus pares en ese momento, por lo que es hora de una pequeña lección de historia. Si queremos entender qué hizo que la primera GPU GeForce fuera tan especial, primero debemos echar un vistazo a los canales 3D de la época.

Era octubre de 1999 y los primeros aceleradores 3D llevaban sólo unos años funcionando. Hasta mediados de la década de 1990, los juegos 3D como Doom y más tarde Quake eran renderizados completamente en software por la CPU, siendo este último uno de los primeros juegos que requería una unidad de punto flotante.

Si desea mostrar un modelo 3D, tiene que pasar por el proceso de gráficos, que en esta etapa era manejado por la CPU. La primera etapa es la geometría, donde la CPU determina el posicionamiento (dónde se ubican los polígonos y vértices en relación con la cámara) y la iluminación (cómo se verán los polígonos bajo la iluminación de la escena). El primero implica transformaciones matemáticas y generalmente se denomina “transformación” y los dos procesos juntos se denominan “transformación e iluminación” o T&L para abreviar.

Una vez definida la geometría, el siguiente paso es rellenar las áreas entre los vértices, lo que se denomina rasterización, y operaciones de procesamiento de píxeles, como comparación de profundidad y búsqueda de texturas. Esto es, por supuesto, una enorme simplificación del proceso de gráficos 3D de la época, pero te da una idea. Comenzamos con la CPU manejando todo el proceso de gráficos de principio a fin, lo que resultó en gráficos de baja resolución, gruesos y un rendimiento deficiente.

Luego tuvimos los primeros aceleradores 3D, como las tarjetas 3dfx Voodoo y VideoLogic PowerVR, que manejaron las últimas etapas del proceso (rasterización y procesamiento de píxeles) y mejoraron enormemente la apariencia y el rendimiento de los juegos, al mismo tiempo que marcaron el comienzo de su uso generalizado. de triángulos en lugar de polígonos para renderizado 3D.

Como la CPU ya no tiene que manejar todas estas operaciones y el hardware dedicado hace el trabajo, puedes renderizar juegos 3D a resoluciones más altas con más detalles y velocidades de fotogramas más rápidas. En este punto, la CPU todavía estaba haciendo bastante trabajo. Si querías jugar juegos 3D, aún necesitabas una CPU decente.

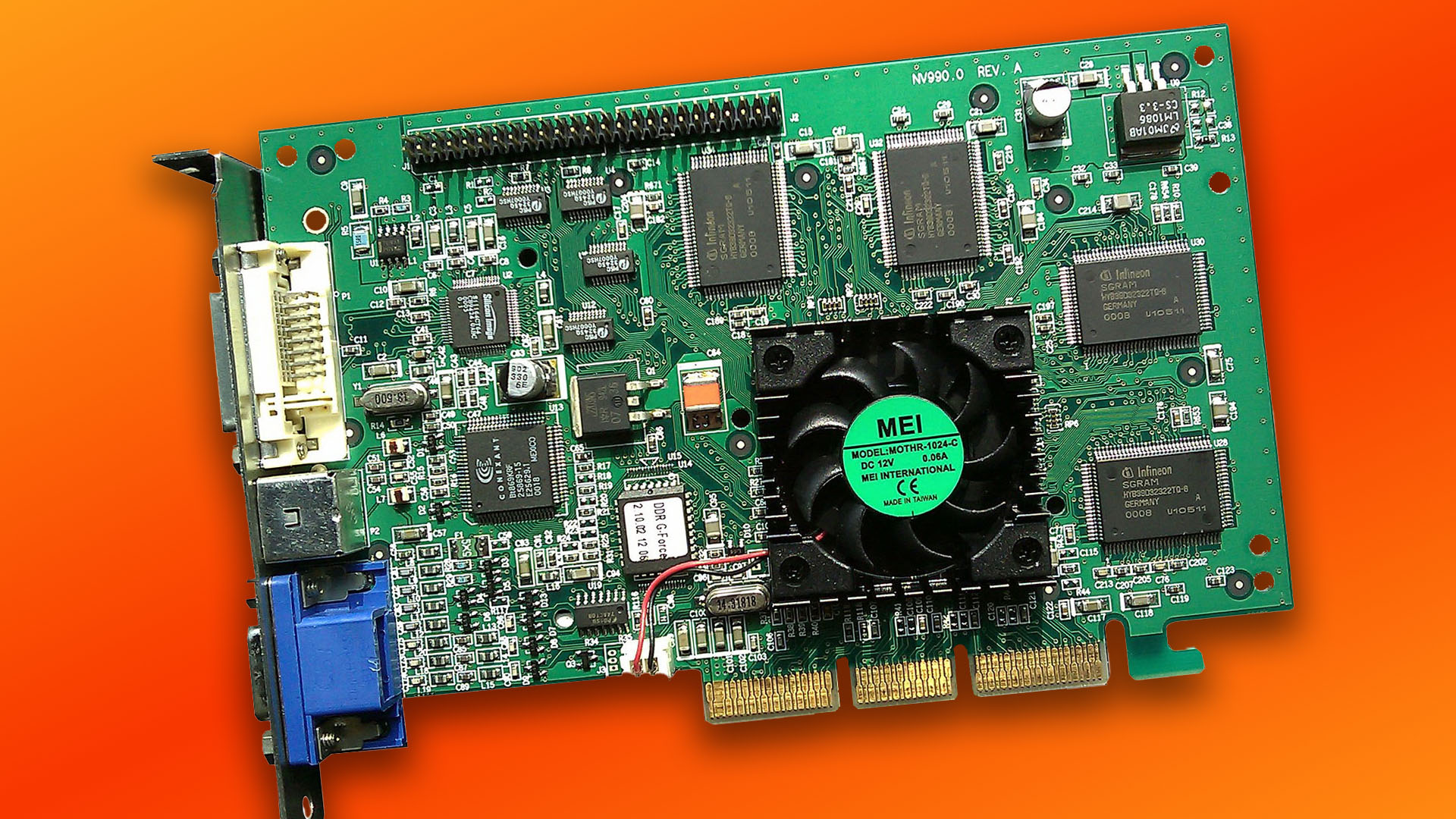

Nvidia pretendía cambiar esta situación con su primera “GPU”, que podía procesar todo el proceso de gráficos 3D, incluidas las etapas iniciales de geometría para transformación e iluminación, en hardware. El único trabajo de la CPU entonces era determinar qué debía renderizarse y hacia dónde iba.

GeForce 256 frente a 3dfx Voodoo 3

Al igual que con cualquier nueva tecnología gráfica, por supuesto, la industria no avanzó instantáneamente hacia el modelo T&L de hardware de Nvidia. En este punto, la única manera real de verlo en acción en DirectX 7 era ejecutar la prueba del helicóptero al inicio de 3DMark2000, aunque algunos juegos que usaban OpenGL 1.2 también lo soportaban.

Este último incluía Quake III Arena, pero la naturaleza poco exigente de este juego significaba que prácticamente funcionaba igual de bien con el software T&L. DirectX 7 tampoco requería T&L acelerado por hardware para ejecutarse; aún se podían ejecutar juegos DirectX 7 usando el software T&L calculado por la CPU, pero no era tan rápido.

Sin embargo, la GeForce seguía siendo un chip gráfico formidable, ya sea que usaras hardware T&L o no. A diferencia del 3dfx Voodoo 3, podía renderizar tanto en color de 32 bits como en 16 bits (al igual que antes el Riva TNT2 de Nvidia), tenía 32 MB de memoria en comparación con los 16 MB más habituales y también superó a sus competidores en la mayoría de los casos. pruebas de juego por un margen sustancial.

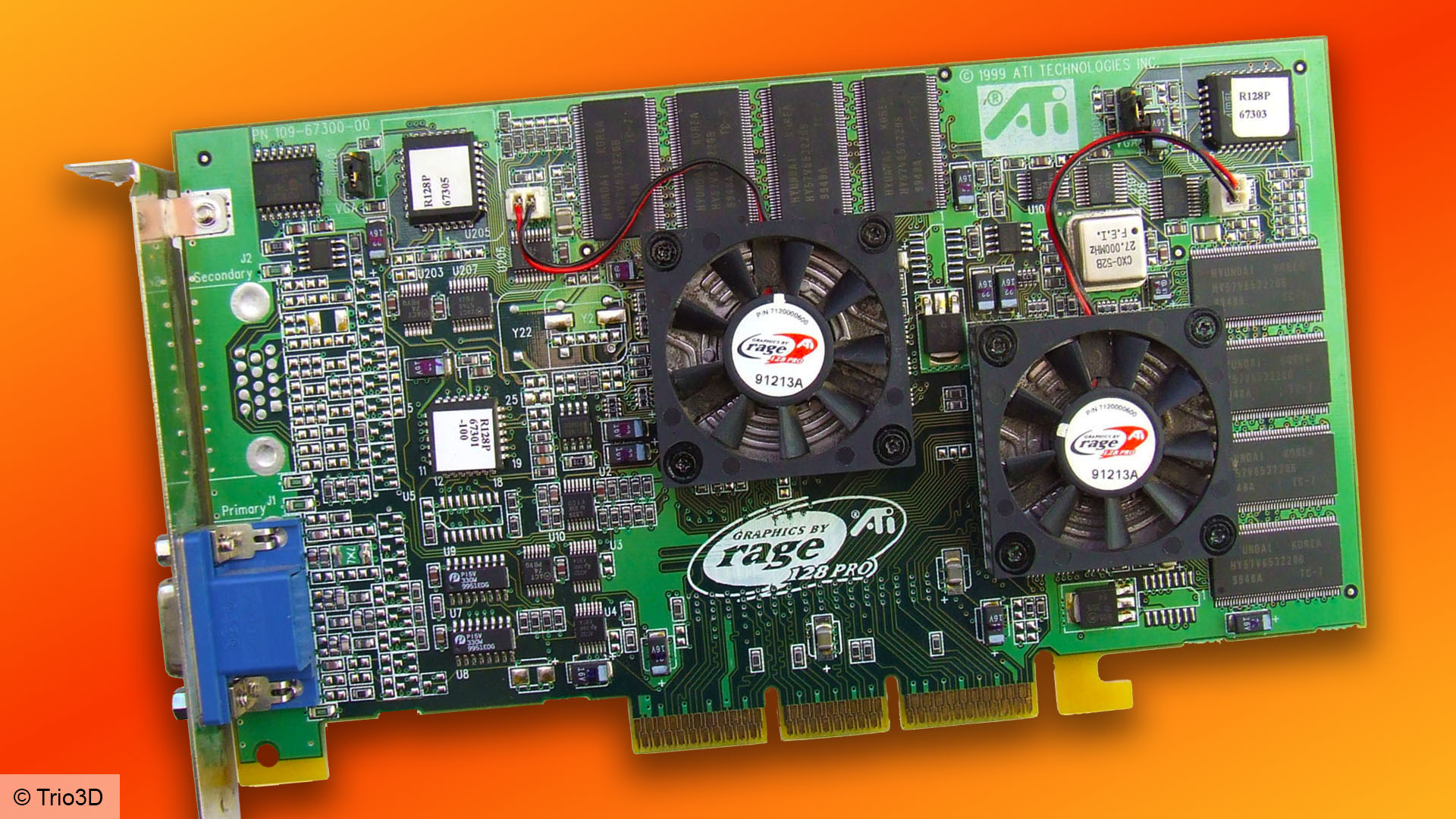

La respuesta de ATi (ahora AMD) en ese momento fue un enfoque de fuerza bruta, colocando dos de sus chips Rage 128 Pro en una PCB para crear el Rage Fury Maxx, usando renderizado de fotogramas alternativos (cada chip gráfico manejaba fotogramas alternativos en secuencia). tenga en cuenta que no estoy usando el término “GPU” aquí) para acelerar el rendimiento. La probé poco después del lanzamiento de la GeForce 256 y efectivamente pudo seguir el ritmo.

La GPU gana

Sin embargo, el protagonismo del Rage Fury Maxx se cortó poco después, cuando Nvidia lanzó la versión DDR de la GeForce en diciembre de 1999, que cambió la SDRAM utilizada en la GeForce 256 original con memoria DDR de alta velocidad. En ese momento, Nvidia había ganado la batalla del rendimiento: nada más podía competir.

También les tomó un tiempo a todos los demás ponerse al día, y en este punto, varias personas en la industria todavía juraban que la velocidad cada vez mayor de las CPU (acabábamos de pasar la barrera de 1 GHz) significaba que el software T&L estaría bien. – Podríamos simplemente continuar con una canalización 3D parcialmente acelerada.

Cuando 3dfx se estaba preparando para el lanzamiento de Voodoo 5 en 2000, recuerdo que tenía preguntas frecuentes en el sitio web. Cuando se le preguntó si Voodoo 5 tendría soporte de software T&L, 3dfx dijo: “Voodoo4 y Voodoo5 tienen soporte de software T&L”. No es deliberadamente deshonesto, pero cada tarjeta gráfica 3D podía admitir software T&L en este momento (lo hacía la CPU); parecía que la respuesta estaba ahí para sugerir furtivamente la paridad de funciones con la GeForce 256.

De hecho, la única otra empresa de gráficos que encontró un competidor decente en un tiempo razonable fue ATi, que lanzó la primera Radeon medio año después, completa con soporte de hardware T&L. Mientras tanto, las líneas 3dfx Voodoo y VideoLogic PowerVR nunca lograron obtener soporte de hardware T&L en la computadora de escritorio, y los chips Voodoo 5 y Kyro II todavía ejecutan T&L en software.

Pero 3dfx todavía estaba adoptando un enfoque de fuerza bruta: encadenando chips VSA-100 en configuración SLI en su próxima gama 3dfx Voodoo 5. El Voodoo 5 5500 finalmente salió al mercado en el verano de 2000, con dos chips, memoria SDRAM lenta y sin hardware T&L. Pudo seguir el ritmo de la GeForce original en algunas pruebas, pero en ese momento Nvidia ya había perfeccionado aún más su hardware DirectX 7 y lanzó la GeForce 2 GTS.

A finales de año, y tras una serie de batallas legales, 3dfx quebró y Nvidia compró sus activos. GeForce y el concepto de GPU habían ganado. Es justo decir que Nvidia merece sus palomitas de maíz verdes.

Esperamos que hayas disfrutado de esta retrospectiva personal sobre la primera GPU Nvidia GeForce. Para obtener más artículos sobre la historia antigua de la PC, consulte nuestra página de tecnología retro de PC, así como nuestra guía sobre cómo construir una PC para juegos retro, donde lo guiaremos a través de todo el hardware que necesita.